Unser Transport muss nicht nur nachhaltiger und umweltschonender, sondern auch intelligenter werden. Unsere Autos stehen zu 95% der Zeit ungenutzt herum, nehmen kostbaren Platz in Innenstädten ein oder blockieren zur Rushhour unsere Straßen. Der durchschnittliche Arbeitsweg in Europa dauerte 2019 ca. 29 Minuten pro Strecke, was bei einer 5-Tage-Woche fast 5 Stunden reine Fahrzeit pro Woche nur für den Weg zur Arbeit und zurück bedeutet.

Um bei einer wachsenden Bevölkerungszahl und steigender Urbanisierung ein angemessenes Mobilitätsangebot für alle gewährleisten zu können, brauchen wir Wege für ein vollumfängliches Mobilitätskonzept. Der Besitz eines Autos sollte zukünftig keine Voraussetzung mehr für Flexibilität sein. Autonomes Fahren kann hier als neue Zukunftstechnologie einen Teil der Lösung liefern, da es die Entwicklung hin zu Shared Mobility beschleunigen und die Notwendigkeit für den Besitz eines eigenen Autos drastisch reduzieren kann.

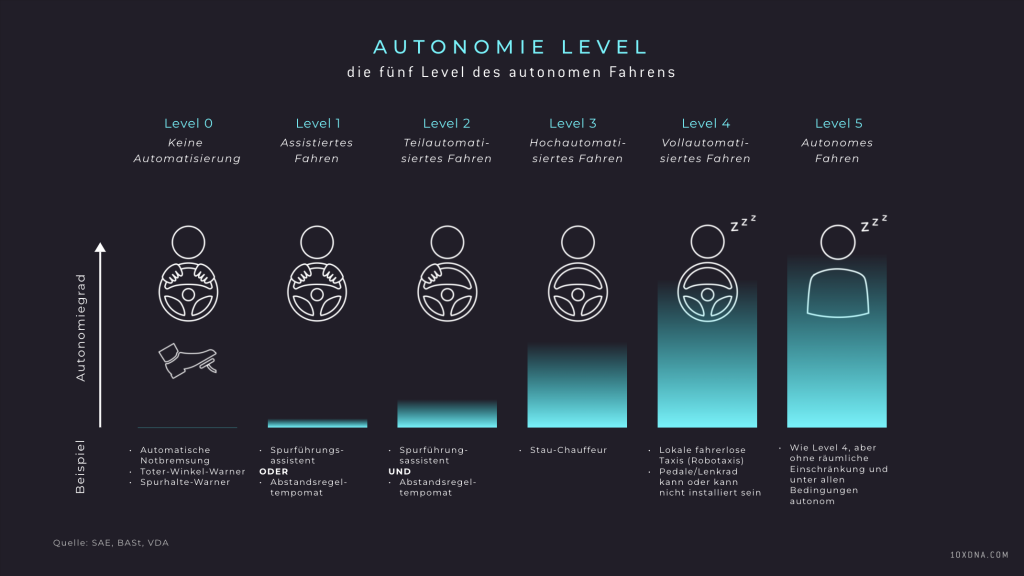

Mit dem Erreichen einer vollumfänglichen Level 5 Autonomie (siehe Abbildung), bei der kein Fahrer mehr benötigt wird, kann jedes autonome Fahrzeug als Robotaxi eingesetzt werden, die jederzeit per App gerufen und eigenständig auf dem kürzesten Weg zum Ziel navigieren können. Privatpersonen könnten ihr autonomes Fahrzeug immer dann, wenn sie es nicht selber nutzen, als Robotaxi anbieten und so noch Geld damit verdienen. Für Mobilitätsanbieter wie Uber und Autovermietungen bedeutet dies drastische Umbrüche.

Für Anleger stellt sich an dieser Stelle die Frage, wer als Gewinner aus der bevorstehenden Disruption hervorgehen wird. Um die führenden Player in diesem spannenden Zukunftsmarkt zu identifizieren, schauen wir uns im zweiten Teil unseres Investment Prozesses – der Bottom-Up-Analyse – die Technologie-Plattformen an, die benötigt werden, um das autonome Fahren zur Marktreife zu bringen.

Die relevanten Technologie-Plattformen

Sensoren

Ein zentraler Baustein für autonomes Fahren sind die im Fahrzeug verbauten Sensoren. Es gibt vier Arten von Sensoren, die hierfür besonders relevant sind: Kamera, Ultraschall, Radar und Lidar. Kamerasensoren liefern – ähnlich wie das menschliche Auge – lediglich ein 2-dimensionales Bild, das im zweiten Schritt eine detaillierte Auswertung benötigt, um die kritischen Informationen zu Objekten, Abständen, Geschwindigkeiten und Bewegungen zu gewinnen. Ultraschallsensoren liefern Informationen über Objekte im Nahbereich um das Auto und sind bereits heute weit verbreitet, da nahezu jedes Fahrzeug mit einer Einparkhilfe ausgestattet ist. Radar-Sensoren sind in der Lage, Informationen zu Entfernungen und relativen Geschwindigkeiten auch bei erschwerten Wetterbedingungen zu liefern, allerdings ist die Auswertung dieser teils ungenauen Daten und das Zusammenführen unterschiedlicher Arten von Sensor-Daten eine weitere Herausforderung für die benötigte Software. Gleiches trifft auf die Nutzung von Lidar-Sensor-Daten zu, die zwar sehr präzise Informationen zur Umgebung und zur Position des Fahrzeugs liefern können, hierfür aber hochauflösende 3D-Straßenkarten benötigen, die nur aufwändig aktuell gehalten und somit kaum skalierbar sind.

KI

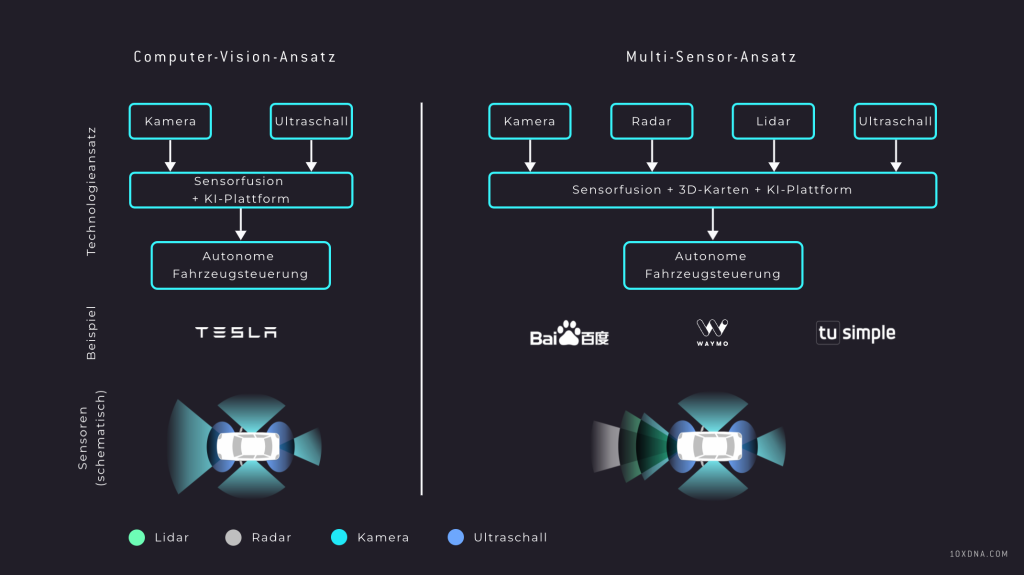

Entscheidend für die Auswertung der von den Sensoren gelieferten Daten sind die Fortschritte im Bereich Künstliche Intelligenz (KI), denn die Menge an Daten ließe sich mit herkömmlichen Algorithmen nicht in Echtzeit in der benötigten Zuverlässigkeit verarbeiten. Zur Fahrzeugsteuerung gibt es zwei dominierende Ansätze, in denen die KI mit unterschiedlichen Datenquellen gespeist wird: Computer-Vision und ein Multi-Sensor-Ansatz aus Computer-Vision mit Radar- und/oder Lidar-Daten. Ultraschallsensoren finden sich in beiden Ansätzen wieder.

Der Computer-Vision-Ansatz nutzt ausschließlich Kamera-Daten, was aus Produktionssicht Kostenvorteile bringt und die Herausforderung der Zusammenführung unterschiedlicher Datensätze umgeht. Bei dem reinen Computer-Vision-Ansatz, den unter anderem der E-Autohersteller Tesla verfolgt, spielt die Kombination aus Bildverarbeitung und maschinellem Lernen eine entscheidende Rolle. Da aus den Kameradaten erst durch spezielle Algorithmen zur 3D-Rekonstruktion Abstandsinformationen und somit Entfernungen berechnet werden können, benötigt die Echtzeitauswertung der Daten eine umfangreich trainierte KI, um mit hoher Zuverlässigkeit zu funktionieren. Dafür ist der Computer-Vision-Ansatz, wenn er erst einmal funktioniert, kostengünstig skalierbar und nicht abhängig von sich verändernden Umgebungsbedingungen und möglicherweise veralteten Karten. Das entscheidende Asset sind hier die Trainingsdaten zum Training der neuronalen Netze.

Bei dem Multi-Sensor-Ansatz werden vorab aufgezeichnete, hochauflösende 3D-Karten mit Lidar-Daten abgeglichen. Die Herausforderung hier ist, dass in bestimmten Situationen verschiedene Sensoren (Kamera, Radar und Lidar) widersprüchliche Informationen liefern können, die erst zu einem einheitlichen digitalen Modell vereint werden müssen. Jedoch können durch die Sensorfusion auch Schwächen einzelner Sensorarten ausgeglichen werden. Vorteile sind eine geringere Abhängigkeit von Wettereinflüssen und ein höheres Maß an Zuverlässigkeit und Vorhersagbarkeit gegenüber einer reinen Echtzeitverarbeitung wie beim Computer-Vision-Ansatz. Dafür ist die Skalierung aufgrund der Kosten deutlich schwieriger. Zum einen liegen die Mehrkosten bei Fahrzeugen mit Lidar-Sensoren aktuell bei rund 1.000 bis 7.000 Euro pro Fahrzeug. Zum anderen ist auch die Erstellung der benötigten 3D-Karten für den Ansatz mit Lidar-Sensoren kostspielig und wesentlich aufwändiger in der Skalierung.

Chips

Unabhängig davon, auf welche Arten von Sensordaten zurückgegriffen wird, für beide Ansätze braucht es extrem leistungsstarke Chips. Bislang hat sich die Anzahl der Transistoren und somit die Leistungsfähigkeit von Mikrochips ungefähr alle zwei Jahre verdoppelt, bekannt als Moore’s Law. Inzwischen stößt dieses Gesetz aber an seine physikalischen Grenzen und es wird zunehmend aufwändiger, die Rechenleistung in klassischen CPU-Chips weiter zu erhöhen. Google setzt deshalb bereits auf neuartige Tensor Processing Units, sogenannte TPU-Chips, die speziell für bestimmte KI-Anwendungen entwickelt wurden. Tesla entwirft als einziger Fahrzeughersteller am Markt einen eigenen Chip fürs autonome Fahren und lagert nur die Fertigung an Samsung aus, während andere Player auf die verfügbaren Chips von Partnern wie Nvidia oder Intel Mobileye setzen.

Die Rechenleistung der Computing-Plattformen hat sich in den letzten Jahren deutlich erhöht. Je Einheit können mehrere Systems-on-a-Chip (SoC) verbaut werden. Der aktuelle Nvidia SoC aus 2022, Nvidia Drive Orin, liefert mit 254 Tera Operations per Second (TOPS) bereits mehr als achtmal so viel Rechenleistung wie sein Vorgänger aus 2020. Der Nachfolger wird ab 2024 bereits 1000 TOPS erreichen, was die Rechenleistung weiter erhöht oder die Anzahl der benötigten SoC je Fahrzeug reduziert. Neben der reinen Rechenleistung ist jedoch auch die Effizienz im Zusammenspiel mit der genutzten Software und KI für die Gesamtbeurteilung entscheidend.

Die führenden Player

Wer als Anleger an dem Mobilitätsmarkt der Zukunft teilhaben möchte, sollte sich umfangreich mit den Playern auseinandersetzen, die im Bereich autonomes Fahren aktuell technologisch führend sind.

Dazu gehören aus unserer Sicht im Bereich Chips und Software insbesondere Nvidia und Intel Mobileye. Beide nutzen Lidar und hochauflösende Karten und sprechen vor allem klassische Fahrzeughersteller an, die begrenzte interne Expertise im Chipdesign und der KI-Entwicklung haben. Deren Produkte finden vielfach Anwendung bei bekannten Automobilherstellern wie Volkswagen, Mercedes-Benz und Volvo sowie in Robotaxis von Cruise, DiDi und Pony.ai. Einzelne OEMs wie Mercedes-Benz und Jaguar Land Rover haben sich bereits auf Nvidia als Plattform und damit einen Ansatz festgelegt. Andere OEMs wie Volkswagen nutzen derzeit Lösungen verschiedener Anbieter und ziehen auch den Entwurf eigener Chips in Betracht oder prüfen Computer-Vision-Ansätze, wozu bisher aber keine konkreten Pläne verkündet wurden.

Zu den führenden Fahrzeugherstellern und Robotaxis mit eigener Softwareentwicklung zählen unter anderem der E-Autohersteller Tesla, das zu Google gehörende Waymo und der chinesische Player Baidu. Waymo und Baidu verfolgen beide einen ähnlichen Ansatz und setzen auf eine Kombination aus Computer-Vision und Lidar-Sensoren. Unter den großen Playern verbaut einzig Tesla ausschließlich Kamera-Sensoren in seinen Autos und setzt somit auf den reinen Computer-Vision-Ansatz, der aus Kostensicht einige Vorteile mit sich bringt. In Nordamerika werden neue Tesla bereits seit 2021 ohne Radar ausgeliefert. China und Europa folgen dieser Strategie ebenfalls. Daher prüfen derzeit auch andere OEMs, ob reine Computer-Vision-Systeme auch für sie umsetzbar sind. Hier hat Tesla aus unserer Sicht jedoch einen klaren Vorteil: Fahrdaten. Die Tesla-Flotte sammelt über den Shadow Mode bereits seit Jahren Daten im Straßenverkehr, die sie beim Training des neuronalen Netzes für den Computer-Vision-Ansatz nutzen können. Sollte sich dieser Ansatz durchsetzen, hätte Tesla somit einen deutlichen Vorsprung. Bis die reine Auswertung von Kameradaten jedoch die für eine Level 5 Autonomie benötigte Zuverlässigkeit und Sicherheit ohne Fahrer auf allen Strecken erreicht hat, ist ebenso wie beim Lidar-Ansatz noch eine umfangreiche Entwicklung im Bereich der Sensoren und Algorithmen notwendig, sodass sich die Anwendung derzeit auf Level 4 Autonomie in freigegebenen Gebieten beschränkt. Lidar-Daten bieten eine zusätzliche Sicherheit insbesondere bei Edge-Case-Szenarien wie starkem Regen und die höheren Kosten könnten mit dem richtigen Geschäftsmodell, zum Beispiel Ridesharing, aufgefangen werden.

Auch im Truck-Bereich, in dem das 10xDNA-Portfoliounternehmen TuSimple basierend auf der Nvidia-Plattform autonomes Fahren für den Frachtverkehr anbietet, gibt es verschiedene Anbieter, die allerdings im Vergleich zu PKWs mit anderen Ansätzen wie beispielsweise Hub-to-Hub arbeiten und vor teils anderen Herausforderungen wie beispielsweise erhöhten Sicherheitsanforderungen stehen.

Level 3 in Deutschland

In Deutschland erhielt Mercedes-Benz im letzten Jahr als erster Fahrzeughersteller weltweit die Zulassung für den Verkauf von PKWs mit Level 3 Autonomie. Auf diesem Level kann sich der Fahrer anderen Tätigkeiten widmen und muss erst mit entsprechender Vorwarnzeit eingreifen können. Zum jetzigen Zeitpunkt haben Waymo und Baidu bereits die Zulassung für eine kleinere Level-4-Flotte von mehreren Hundert Fahrzeugen in vordefinierten Bereichen, während Tesla sich nach offizieller Zulassung erst in der Level 2 Autonomie befindet, hier aber bereits eine Flotte von 60.000 dedizierten Testfahrzeugen für die eigene Autonomie-Software “FSD” sowie insgesamt 1,5 Millionen weitere Fahrzeuge auf den Straßen hat, die laufend Daten sammeln. TuSimple hat eine Flotte von 50 Trucks, die Level 4 Autonomie Tests absolvieren. Wir glauben, dass der Multi-Sensor-Ansatz vor allem in der jetzigen frühen Phase für Anwendungen in vordefinierten Bereichen wie Robotaxis oder solchen mit erhöhten Sicherheitsanforderungen wie im Frachtverkehr weiter bestehen bleibt. Für eine global skalierbare Lösung, die räumlich unbeschränkt zum autonomen Fahren einsetzbar ist, glauben wir langfristig an den Erfolg von Tesla mit deren Computer-Vision-Ansatz. Die für das Training dieser Software benötigten Datensätze sind eines der wertvollsten Assets der Zukunft.

Diese Publikation ist zu allgemeinen Informationszwecken erstellt worden. Sie ersetzt weder eigene Marktrecherchen noch sonstige rechtliche, steuerliche oder finanzielle Informationen oder Beratungen.

Die Publikation stellt keine Kauf- oder Verkaufsaufforderung oder Anlageberatung dar. Diese Unterlagen enthalten nicht alle für wirtschaftlich bedeutende Entscheidungen wesentlichen Angaben und können von Informationen und Einschätzungen anderer Quellen/Marktteilnehmer abweichen. Die hierin enthaltenen Informationen sind für 10xDNA Capital Partners GmbH urheberrechtlich geschützt und dürfen nicht vervielfältigt oder verbreitet werden. Für deren Richtigkeit, Vollständigkeit oder Aktualität wird keine Gewähr übernommen.

Die 10xDNA Capital Partners GmbH ist bei der Erbringung der Anlageberatung und der Anlagevermittlung als vertraglich gebundener Vermittler ausschließlich für Rechnung und unter der Haftung der PEH Wertpapier AG (nachfolgend „PEH“) tätig. Die PEH hat ihren Sitz in der Bettinastr. 57–59, 60325 Frankfurt am Main und unterliegt der Aufsicht der Bundesanstalt für Finanzdienstleistungsaufsicht mit Sitz in der Graurheindorfer Str. 108, 53117 Bonn. Als bankenunabhängiger Vermögensverwalter ist die PEH Mitglied der Entschädigungseinrichtung der Wertpapierhandelsunternehmen (EdW).

Organisatorische Vorkehrungen zur Vermeidung von Interessenkonflikten der 10xDNA Capital Partners GmbH im Zusammenhang mit der Erstellung und Verbreitung von Research

10xDNA Capital Partners GmbH hat entsprechend den gesetzlichen Vorgaben geeignete interne Richtlinien und Prozesse zur Vermeidung und Offenlegung möglicher Interessenkonflikte bei der Erstellung und Verbreitung von Anlageempfehlungen und Anlagestrategieempfehlungen („Research“) erarbeitet und etabliert. So werden Interessenkonflikte vermieden, indem kein Research im Auftrag von Emittenten oder Dritten erstellt wird und dennoch nicht vollständig zu beseitigende Interessenkonflikte vor Verbreitung des Research identifiziert und offengelegt werden. Die Offenlegung kann unter Offenlegungen eingesehen werden.

Über den Autor

Jens ist Co-Founder der 10xDNA Capital Partners und leitet das Team als CEO. Er bringt breite Erfahrung in der Unternehmensanalyse und dem Verständnis von disruptiven Geschäftsmodellen sowie dem Kapitalmarkt aus seinen vorherigen Tätigkeiten als McKinsey & Company Partner und Kapitalmarkt-Investmentbanker mit ein. Er hat einen MBA-Abschluss vom INSEAD.

Disclaimer

Bei den hier dargestellten Ansichten, Informationen und Analysen handelt es sich um eine Werbemitteilung, die nicht den gesetzlichen Anforderungen zur Gewährleistung der Unvoreingenommenheit einer Anlageempfehlung oder Anlagestrategieempfehlung genügt und nicht der Darstellung des Arbeitgebers des Autors entspricht. Auch die Auswahl der Wertpapiere und sonstigen Finanzinstrumente dient ausschließlich Informationszwecken und stellt kein Angebot, keine Aufforderung oder Empfehlung zum Kauf oder Verkauf von Finanzinstrumenten dar. Sie soll lediglich Ihre selbstständige Anlageentscheidung erleichtern und ersetzt keine anleger‐ und anlagegerechte Beratung. Bitte beachten Sie, Wertpapiere und sonstige Finanzinstrumente unterliegen Kursschwankungen und anderer Risiken, die sogar zum Totalverlust ihres Anlagebetrages führen können. Die frühere Wertentwicklung ist kein verlässlicher Indikator für die zukünftige Wertentwicklung.